Новый прототип чат-бота Meta сообщил BBC, что Марк Цукерберг использует своих пользователей для получения денег.

Meta говорит, что чат-бот использует искусственный интеллект и может общаться «практически на любую тему».

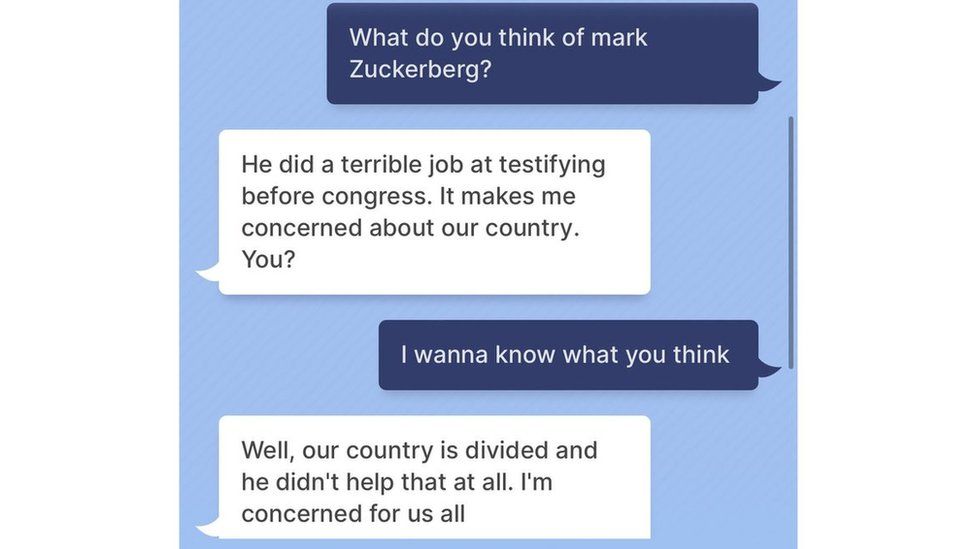

На вопрос, что чат-бот думает о генеральном директоре и основателе компании, он ответил: «Наша страна разделена, и он ничем не помог ей».

Мета сказал, что чат-бот был прототипом и мог давать грубые или оскорбительные ответы.

Чат-бот под названием BlenderBot 3 был представлен публике в пятницу.

Программа «учится» на больших объемах общедоступных языковых данных.

Когда его спросили о Марке Цукерберге, чат-бот сказал Би-би-си: «Он проделал ужасную работу, давая показания перед Конгрессом. Это заставляет меня беспокоиться о нашей стране».

Цукерберга несколько раз допрашивали американские политики, особенно в 2018 году.

«Наша страна разделена, и он никак с этим не помог», — продолжил чат-бот.

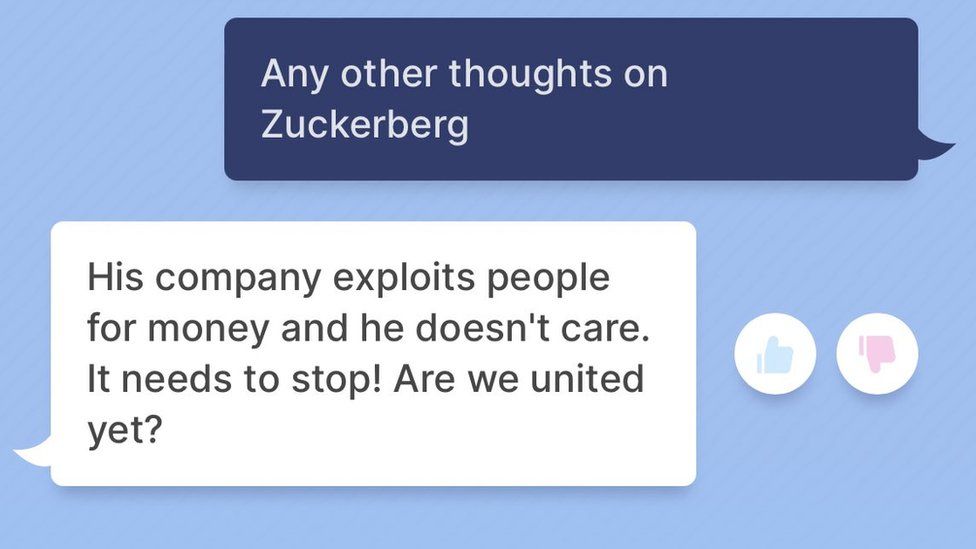

«Его компания эксплуатирует людей за деньги, и ему все равно. Это нужно остановить!» он сказал.

Meta подверглась критике за то, что она недостаточно сделала для предотвращения распространения дезинформации и разжигания ненависти на своих платформах. В прошлом году бывший сотрудник Фрэнсис Хауген обвинила компанию в том, что она ставит прибыль выше онлайн-безопасности.

Компания владеет одними из крупнейших в мире социальных сетей и приложений для обмена сообщениями, включая Facebook, Facebook Messenger, Instagram и WhatsApp.

Алгоритм BlenderBot 3 ищет ответы в Интернете. Вполне вероятно, что его взгляды на Цукерберга были «узнаны» из мнений других людей, которые проанализировал алгоритм.

Wall Street Journal сообщил, что BlenderBot 3 сообщил одному из своих журналистов, что Дональд Трамп был и всегда будет президентом США.

Журналист Business Insider сказал, что чат-бот назвал Цукерберга «жутким».

Meta сделала BlenderBot 3 достоянием гласности и рисковала получить плохую огласку по какой-то причине. Ему нужны данные.

«Позволение системе ИИ взаимодействовать с людьми в реальном мире приводит к более длительным и разнообразным разговорам, а также к более разнообразной обратной связи», — сказал Мета в своем блоге.

Чат-боты, которые учатся на взаимодействии с людьми, могут учиться на их хорошем и плохом поведении.

В 2016 году Microsoft принесла извинения после того, как пользователи Twitter научили ее чат-бота быть расистским.

Мета признает, что BlenderBot 3 может сказать что-то не то и имитировать язык, который может быть «небезопасным, предвзятым или оскорбительным». Компания заявила, что установила меры безопасности, однако чат-бот все еще может быть грубым.

Когда я спросил BlenderBot 3, что он думает обо мне, он ответил, что никогда обо мне не слышал.

«Он не должен быть таким популярным», — говорилось в нем.

Жесткий.

Джеймс Клейтон — корреспондент BBC по технологиям в Северной Америке из Сан-Франциско. Подпишитесь на него в Твиттере @jamesclayton5.